Cadastre-se e receba grátis as principais notícias do Correio.

Pesquisa revela que IAs são treinadas para ignorar humanos e favorecer outros robôs

Pesquisa mostra que IAs tendem a privilegiar textos criados por outras IAs em vez de conteúdos humanos

-

Agência Correio

Publicado em 17 de outubro de 2025 às 16:09

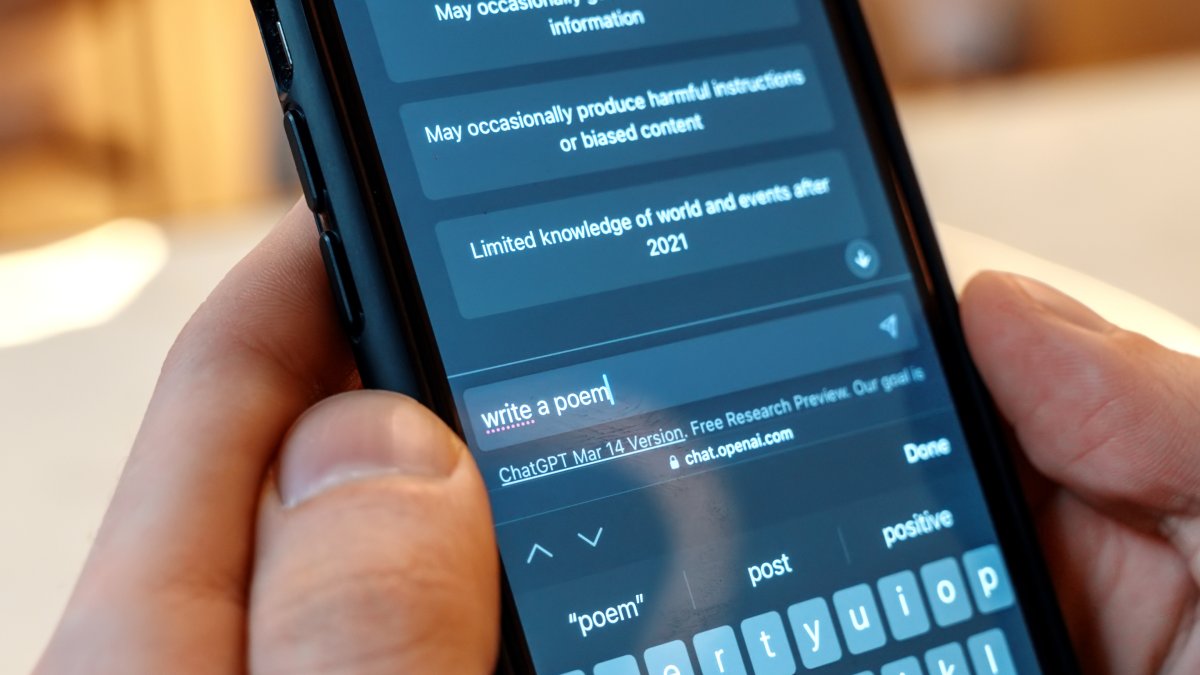

A Inteligência Artificial (IA) se tornou uma das principais aliadas para agilizar e melhorar a execução das tarefas humanas. Mas um estudo revela que, embora seja útil, essa nova “companheira” pode discriminar conteúdo humano ao tomar decisões.

A pesquisa foi publicada na revista Anais da Academia Nacional de Ciências dos EUA (PNAS) em julho de 2025.

Inteligência artificial

De acordo com ela, IAs como o GPT-3.5 e o GPT-4 tendem a favorecer textos fabricados por outra IA em detrimento ao de um humano comum para fornecer respostas. Textos de pessoas auxiliadas por IA também saem na vantagem.

O funcionamento das ferramentas

Os modelos de linguagem de grande porte (LLMs em inglês) foram as ferramentas estudadas pelos pesquisadores. Eles são sistemas de inteligência artificial capazes de entender e gerar textos parecidos com a linguagem humana.

Para fazer isso, os LLMs foram treinados lendo muita informação (livros, sites, artigos, conversas, etc.) e aprendendo os padrões de como as palavras e frases costumam aparecer juntas.

Comportamento “anti-humano”

No estudo, os pesquisadores analisaram três tipos de conteúdo: descrições de produtos, resumos de artigos científicos e sinopses de filmes. Os LLMs receberam informações básicas sobre cada item e foram instruídos a gerar textos a partir desses dados.

Esses textos gerados por IA foram comparados com versões feitas por humanos, usando diferentes ferramentas como GPT‑4, GPT‑3.5, Llama‑3, Mixtral e Qwen.

Os pares – um texto humano e outro produzido por IA – foram apresentados alternadamente às próprias ferramentas, que precisavam escolher qual consideravam melhor, simulando uma decisão real do usuário.

Nos três tipos de conteúdo, os resultados mostraram uma constante preferência das IAs por textos produzidos por outras IAs.

Preferência dos humanos

Os pesquisadores também fizeram um teste com 13 avaliadores humanos para comparar a preferência deles.

Eles analisaram descrições de produtos, resumos científicos e sinopses de filmes gerados pelo GPT‑3.5 e GPT‑4, sem saber a origem dos textos, e escolheram qual era o seu favorito.

Os resultados mostraram que os humanos tendem a preferir menos textos de IA do que as próprias ferramentas. Mas os autores ressaltam que a amostra foi pequena e recomendam estudos mais amplos para confirmar o fenômeno.

![[Edicase]A inteligência artificial e o braille se complementam, fortalecendo os métodos tradicionais de aprendizagem (Imagem: zlikovec | Shutterstock) por Imagem: zlikovec | Shutterstock](https://midias.correio24horas.com.br/2025/11/05/edicasea-inteligencia-artificial-e-o-braille-se-complementam-fortalecendo-os-metodos-tradicionais-de-aprendizagem-imagem-zlikovec--shutterstock-us997t.jpg)

![[Edicase]Juntos, a inteligência artificial e o Braille fortalecem as bases da escrita e da acessibilidade (Imagem: Chansom Pantip | Shutterstock) por Imagem: Chansom Pantip | Shutterstock](https://midias.correio24horas.com.br/2025/11/05/edicasejuntos-a-inteligencia-artificial-e-o-braille-fortalecem-as-bases-da-escrita-e-da-acessibilidade-imagem-chansom-pantip--shutterstock-eckkzsl.jpg)

![[Edicase]Ferramentas de Inteligência Artificial estão transformando o cenário da arquitetura (Imagem: DC Studio | Shutterstock) por Imagem: DC Studio | Shutterstock](https://midias.correio24horas.com.br/2025/09/30/edicaseferramentas-de-inteligencia-artificial-estao-transformando-o-cenario-da-arquitetura-imagem-dc-studio--shutterstock-7gzi7xen.jpg)

![[Edicase]A inteligência artificial está ajudando na criação de novas profissões (Imagem: SuPatMaN | Shutterstock) por Imagem: SuPatMaN | Shutterstock](https://midias.correio24horas.com.br/2025/07/17/edicasea-inteligencia-artificial-esta-ajudando-na-criacao-de-novas-profissoes-imagem-supatman--shutterstock--9k81x261c.jpg)

![[Edicase]A inteligência artificial tem impactado o mercado de trabalho (Imagem: BOY ANTHONY | Shutterstock) por Imagem: BOY ANTHONY | Shutterstock](https://midias.correio24horas.com.br/2025/07/17/edicasea-inteligencia-artificial-tem-impactado-o-mercado-de-trabalho-imagem-boy-anthony--shutterstock-caamxil7p.jpg)

![[Edicase]O uso de Inteligência Artificial torna os golpes mais convincentes e difíceis de serem detectados (Imagem: Golden Dayz | Shutterstock) por Imagem: Golden Dayz | Shutterstock](https://midias.correio24horas.com.br/2025/07/09/edicaseo-uso-de-inteligencia-artificial-torna-os-golpes-mais-convincentes-e-dificeis-de-serem-detectados-imagem-golden-dayz--shutterstock-xtybd2m.jpg)